Waarom is context belangrijk voor een LLM?

Door context toe te voegen leert een LLM zijn gebruiker kennen. „Het taalmodel kan hierdoor informatie filteren en in context brengen zodat hij informatie geeft die voor jou relevant is”, vertelt Lapperre.

De tekstschrijver verduidelijkt dat het niet alleen bedoeld is voor onboarding van het model, maar ook voor het werkproces zelf. „Tijdens een gesprek met het taalmodel kun je zeggen: ‘Stop, ik wil dat je dit nu onthoudt en dat je dit altijd op deze manier doet’. Je moet de memory van het model corrigeren.”

Lees ook: Met deze AI-toepassing bouw je zelf heel makkelijk een website, volgens AI-expert Job van den Berg

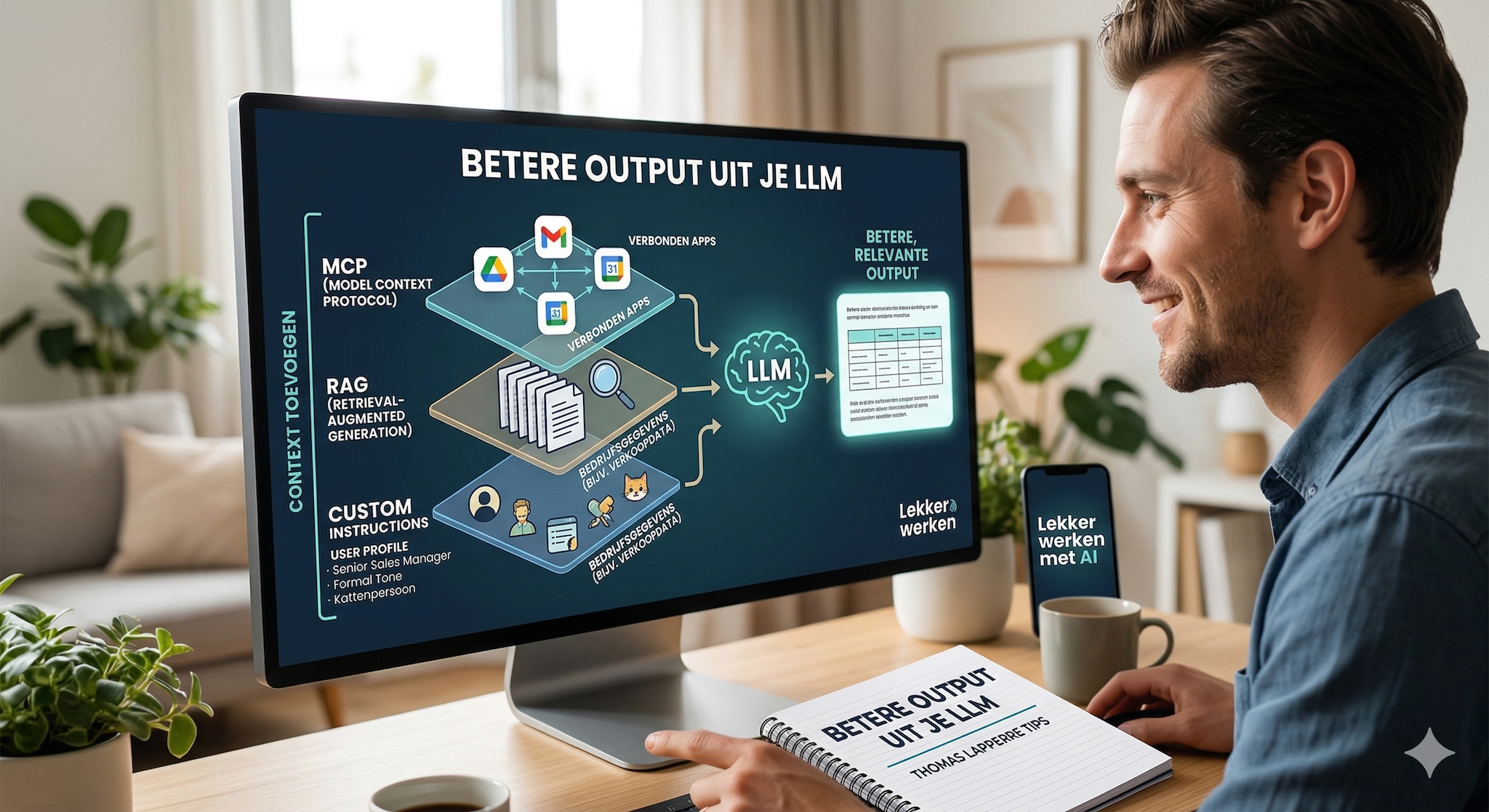

RAG, Custom Instructions en MCP

Met behulp van een paar methodes zoals RAG, MCP of Custom Instructions kan een gebruiker het brein van een taalmodel trainen. Volgens AI-tekstschrijver Lapperre is dit essentieel voor een betere output.

Retrieval-Augmented Generation AI (RAG) is een techniek waarmee de gebruiker het taalmodel slimmer maakt door het toegang te geven tot specifieke, externe informatie die niet is gebruikt bij het bouwen van het taalmodel. Denk hierbij aan bedrijfsspecifieke informatie zoals financiële data of salesdata. Dit is volgens Lapperre de moeilijkste van de drie contextmethodes. „Dit is niet iets wat je even op een verjaardagsfeestje gaat aanhalen. Het is uiteindelijk een database.”

Model Context Protocol (MCP) is een open-sourcestandaard waarmee de gebruiker het taalmodel buiten zijn eigen brein kan laten kijken. De LLM kan hierdoor informatie zoals facturen in een Google Drive automatisch uitwerken in een Excel-bestand. MCP is de eerste stap naar een AI-agent. „Hiermee kun je niet alleen databases aansluiten, maar je kunt apps en software toevoegen zoals Google Agenda, je Gmail.” Het is vooral bedoeld om projecten persoonlijk te automatiseren.

Custom Instructions is een manier waarmee je het taalmodel vaste gebruikersaanwijzingen geeft waarbij de LLM bij elk antwoord deze instructies in gedachten houdt. Voorbeeld: ‘Jij bent een senior salesmanager die altijd formeel antwoord geeft, bij iedere vraag over KPI’s wil ik een overzichtelijk tabel’. Dit is makkelijk toe te passen tijdens het prompten. „Hiermee geef je een tone-of-voice aan je taalmodel. Door achtergrondinformatie toe te voegen zoals ‘ik kom uit Den Helder’ of ‘Ik ben een kattenpersoon’ weet het taalmodel dat het dat moet meenemen in de output.”

Het stappenplan voor betere output van een LLM

Lapperre legt daarbij uit dat het belangrijk is om een goed stappenplan op te stellen. „Goede context aan een prompt geven doe je eigenlijk in lagen en verschillende stappen. De eerste stap begint al op het moment dat je een model kiest. Ik werk graag met Claude, omdat het een goede tekstschrijver is. Voor andere zaken kun je juist weer beter ChatGPT gebruiken.”

De tweede stap is onderverdeeld in drie punten. „Je moet jezelf afvragen wat je wil automatiseren. Dat taalmoel train je door jouw eigen context te geven. Dit doe je op profielniveau. Wat voor tone-of-voice moet mijn LLM gebruiken, wat voor antwoorden wil ik en welke interactie is voor mij belangrijk?”

Normaal leert het taalmodel dit gaandeweg, maar stel dat je bijvoorbeeld overstapt van ChatGPT naar Claude, dan kun je het ‘brein’ al voeden. „Bij de instellingen vind je een tabblad ‘memory’. Hier kan je allemaal achtergrondinformatie in kwijt. Dan houdt het taalmodel daar al gelijk rekening mee.”

De tips van Thomas Lapperre liever beluisteren? Dat kan in de podcast Lekker werken met AI:

Ontvang elke week het beste van BusinessWise in je mailbox. Schrijf je hier nu gratis in: