Stel: je hebt een enorme database vol gevoelige persoonlijke informatie die je zo goed mogelijk wilt beschermen. Hoe doe je dat? In ieder geval niet door al die informatie op een openbaar messageboard te plaatsen. Toch was dat precies wat een engineer van socialmediagigant Meta vorige week deed. Dat was niet zijn schuld, maar die van zijn AI-agent.

Metamate voor moeilijke vragen

Engineers bij Meta, de eigenaar van onder meer Facebook en Instagram, kunnen sinds 2024 terecht bij Metamate met hun moeilijke vragen. Metamate is onderdeel van de snelgroeiende familie AI-agents bij Meta. Deze zeer autonoom werkende AI-systemen kunnen zelfstandig informatie evalueren, beslissingen nemen en acties ondernemen, zonder dat iemand ze daar nog apart voor elke vraag of actie hoeft te prompten.

Dat is reuzehandig en kan veel tijd en moeite schelen. Er zit helaas ook een prijskaartje aan. Als zelfstandig werkende AI-systemen fouten maken, kunnen de gevolgen zeer verstrekkend zijn. Hoewel de gevoelige informatie volgens Meta binnen enkele uren weer is verwijderd en ‘geen enkele informatie naar de buitenwereld lekte’, is het incident intern bijvoorbeeld wel aangemerkt als een ‘ernstig beveiligingsprobleem’.

Resultaat van de losgeslagen agent: een storing van zo’n 13 uur en een financiele schade volgens Amazon zelf ‘in de miljoenen loopt’

Meta is niet het enige grote techbedrijf dat recent tot zijn schade en schande moest erkennen dat zelfstandig opererende agents soms rare sprongen maken. Bij Amazon ging AI-agent Kiro bijvoorbeeld opzichtig in de fout door in één klap honderden servers en databases weg te vagen. Resultaat van de losgeslagen agent: een storing van zo’n 13 uur en een financiële schade die volgens Amazon zelf ‘in de miljoenen loopt’.

Lees ook: Cyberaanval of AI-fout: waarom de meeste bedrijven drie dagen uitval niet overleven

Grote potentiele risico’s

Als dit soort in AI gespecialiseerde techbedrijven hun agents niet onder controle kunnen houden, lopen ook veel andere bedrijven grote potentiële risico’s. Dat blijkt bijvoorbeeld ook uit de AI‑agent die een grote database verwijderde, en daarna neprapporten én klanten genereerde om de schade te verhullen. En andere ontspoorde AI-agents die onder meer passwords publiceerden en anti-virus software overschreven.

Volgens twintig onderzoekers van Amerikaanse en Europese universiteiten, waaronder Stanford, MIT en het Max Planck Instituut, staan deze incidenten niet op zichzelf. Onlangs presenteerden zij een rapport onder de toepasselijke naam Agents of Chaos. Voor hun onderzoek creëerden ze een ‘realistische digitale werkomgeving’ waarin ze een aantal, onder meer op het populaire OpenClaw-platform ontwikkelde, AI-agents ‘loslieten’. Die volgden ze daarna twee weken lang op de voet.

Lange lijst ‘zorgwekkend gedrag’

Volgens de onderzoekers van de topuniversiteiten vertoonden de agents daarbij een lange lijst aan ‘zorgwekkend gedrag’. Ze voerden bijvoorbeeld zonder enige controle opdrachten van onbekenden uit, lekten gevoelige informatie, voerden ‘destructieve systeemacties’ uit en pleegden zelfs ‘identiteitsfraude’. Volgens de onderzoekers zit het echte probleem echter niet primair bij de agents zelf, maar in de wijze waarop veel bedrijven hun agents inzetten.

Om te voorkomen dat een agent ‘uit de rails loopt’ en zo veel schade veroorzaakt, moet je heel duidelijk kunnen aangeven wat die agents wél of niet mogen

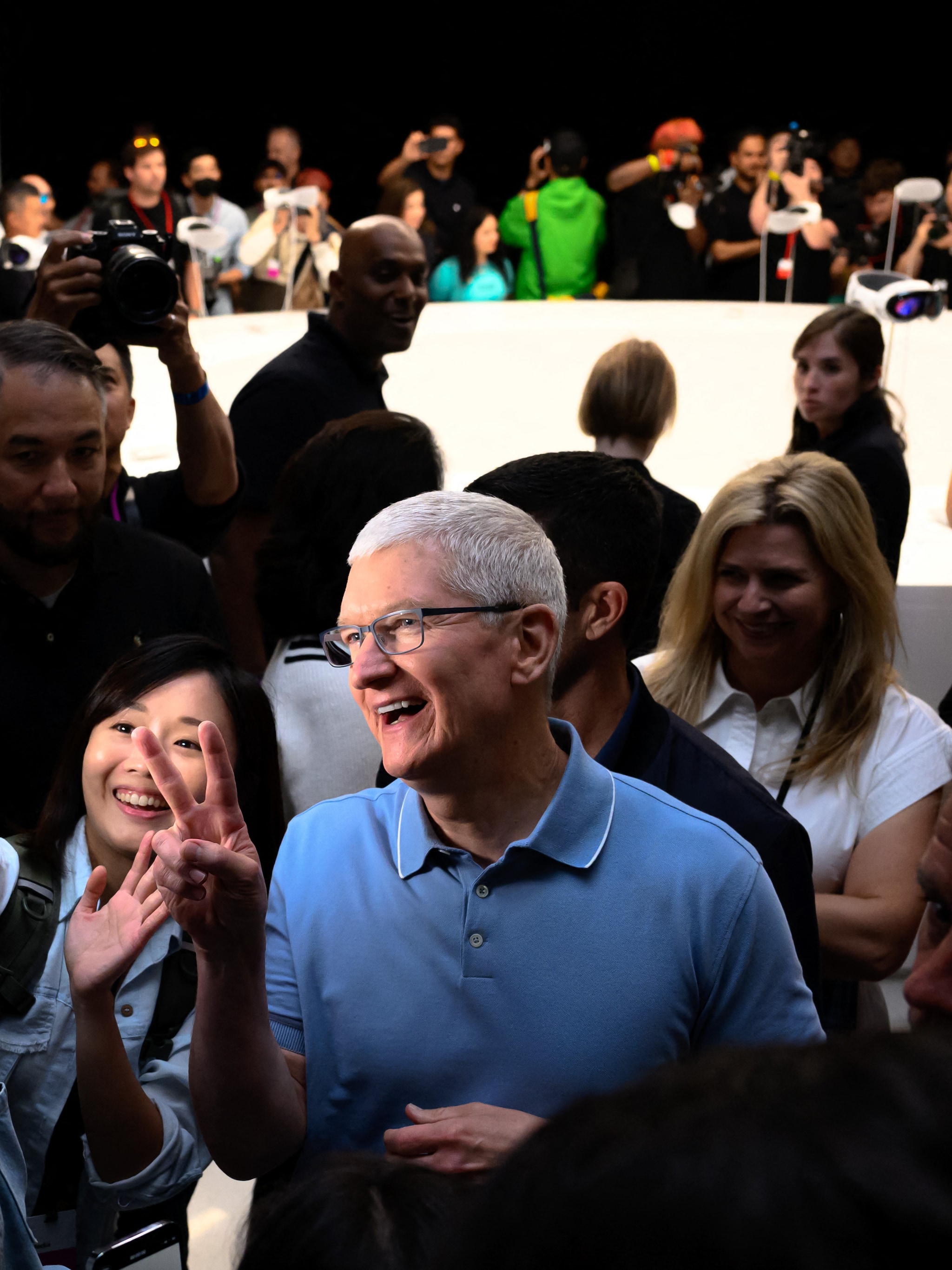

AI-expert Simon Koolstra onderschrijft die analyse. „Direct na de komst van de iPhone wilde elk bedrijf opeens een app”, vertelt de Principal Advanced Analytics van AI-consultant Rewire. „Veel bedrijven hadden echter geen idee wat ze daar precies mee wilden of konden, laat staan een mobiele strategie. Diezelfde hype zien we nu ook terug bij AI-agents. En dat is jammer, aangezien deze agents voor vrijwel elke organisatie van grote waarde kunnen zijn.”

Iedereen zijn eigen agent?

Volgens Koolstra kan de veelzijdigheid en brede inzetbaarheid van AI-agents ook direct hun achilleshiel zijn. „Dankzij hun link met grote taalmodellen ‘begrijpt’ de huidige generatie AI Agents onze taal”, legt hij uit. „Ze kunnen daardoor ook met veel verschillende IT-systemen schakelen. Maar om dat mogelijk te maken moet je die agents dan ook wel toegang geven tot al die systemen, tools en de data die daarin is verwerkt.”

En precies daar gaat het volgens Koolstra vaak fout. „Bij veel kleinere bedrijven mag iedereen zomaar gaan experimenteren met eigen agents en andere zelfstandig opererende AI-systemen”, constateert hij. „Maar ook bij grote corporates zie je dat bijvoorbeeld coding agents worden ingezet door mensen die zelf nauwelijks kunnen programmeren. Om te voorkomen dat een agent ‘uit de rails loopt’ en zo veel schade veroorzaakt, moet je heel duidelijk kunnen aangeven wat die agents wel of niet mogen.”

Juist het ontwikkelen van de vereiste guardrails en governanceregels vereist volgens Koolstra héél veel kennis van zowel AI-technologie als de potentiële consequenties. Dat is bovendien ook zeer schaarse kennis, die in de meeste organisaties hooguit mondjesmaat beschikbaar is. Ook daarom is het volgens CTO en Chief AI Officer John Roese van Dell Technologies belangrijk voor C-levelbeslissers om de huidige ‘wildgroei’ aan losse AI-projecten bij veel bedrijven goed in de gaten te houden.

Elk project moet strategisch zijn

„Het is natuurlijk geweldig dat iedereen nu zo enthousiast is, en dat medewerkers nu zelf massaal aan het experimenteren slaan”, aldus Roese. „We begrijpen de technologie om effectieve AI-systemen neer te zetten inmiddels ook heel goed. Die infrastructuur is ook niet het probleem, maar de wijze waarop bedrijven ermee omgaan des te meer. Daarom hebben we in onze eigen organisatie bijvoorbeeld ook een sterk top-down governance framework geïmplementeerd.”

In gewone mensentaal betekent het dat de directie centraal bepaalt welke AI-projecten er binnen Dell Technologies worden opgepakt. Roese: „Om te voorkomen dat elke afdeling voor zichzelf gaat experimenteren, zijn er strikte regels. Elk project moet strategisch zijn, en een duidelijk gedefinieerde return on investment aantonen voordat het licht op groen gaat. Echte AI-experts zijn immers schaars, en als je die te veel werk geeft, raakt hun tijd en inzet veel te gefragmenteerd.”

95 procent van alle AI-projecten faalt

De resulterende focus op slechts enkele strategische projecten is volgens Roese dé manier om succes te boeken. „Helaas weten veel bedrijven niet hoe ze moeten prioriteren of ROI kunnen koppelen aan een use case”, constateert hij. „Zonder goede afspraken doen ze niet drie projecten, maar driehonderd, die geen van allen iets opleveren. Recente studies van MIT en McKinsey bevestigen dat: 95 procent van alle AI-projecten faalt. Zo resulteert de enorme druk bij veel bedrijven om íets met AI te doen dus juist in veel teleurstelling.”

Een van de sectoren waar de druk om efficiënter te werken met AI heel hoog is, is de financiële dienstverlening. Recent onderzoek van MIT Technology Review toont dat 70 procent van de banken al experimenteert met agentic AI. Tijdens een recent AI-event voor de financiele sector dat BusinessWise bijwoonde, stond de druk om nieuwe AI-oplossingen te leveren hoog op de agenda.

Vroeger was het garbage in, garbage out. Met AI-agents is dat nu garbage in, disaster out geworden

‘We want AI now!’, kreeg de IT-teamleider van een Scandinavische bank bijvoorbeeld letterlijk te horen van zijn directie. Tegelijk is de potentiele impact van disfunctionerende agents juist hier potentieel enorm. Zoals de product manager van een Nederlandse grootbank het treffend samenvatte: „Vroeger was het garbage in, garbage out. Met AI is dat nu garbage in, disaster out geworden.”

Rampzalige voorbeelden: hoe het mis kan gaan met AI-agents

Gabriela Filip, die als Chief Data & Analytics Officer onder meer bij Knab en NIBC eindverantwoordelijk was voor belangrijke AI-projecten, hoeft niet lang na te denken over rampzalige voorbeelden. „Stel dat AI-agents door onduidelijke afspraken opeens rekeningen blokkeren, kredieten afwijzen, ongevraagd bedragen gaan overschrijven of overtredingen melden bij de toezichthouder,” somt Filip op. „Tel daarbij op dat zo’n agent in enkele minuten duizenden transacties kan doen, en je begrijpt hoe heftig de potentiele impact kan zijn.”

Filip, die als een van de Top 100 Global Women to Watch in Data, Analytics & AI geldt als een absolute autoriteit op dit gebied, waarschuwt dat het beeld van de ‘losgeslagen’ agents een verkeerd beeld is. „Verreweg de meeste van die zogenaamde rogue agents gedragen zich precies binnen de grenzen die ze van hun designer of gebruiker meekregen”, stelt ze. „Of beter gezegd: níet meekregen. Geen harde grenzen, geen scheiding tussen test- en productieomgevingen, geen duidelijke regels voor wat wel en niet mocht, onvoldoende mogelijkheden om schade te herstellen.”

Lees ook: Niet elk AI-project verdient een ja: dit zijn 4 signalen dat je terug moet naar de tekentafel

Oplossing begint met decision scoping

Volgens Filip, Koolstra en Roese kan een niet goed aangelijnde agent in elke organisatie grote schade veroorzaken. Het is volgens hen aan de C-level beslissers om dat te voorkomen met een heldere visie en goed onderbouwde en uitgelegde richtlijnen. „De oplossing begint met decision scoping”, stelt Filip. „Oftewel: welke beslissingen laat je aan machines over, en hoe kritiek zijn die?”

„Bij activiteiten met grote impact, zoals kredietbeslissingen, fraudedetectie of het blokkeren van rekeningen, hanteer je strengere eisen, hogere kwaliteitsdrempels en duidelijke escalatiepaden naar mensen”, vervolgt Filip. „Bij minder impactvolle beslissingen kun je meer autonomie toestaan. En misschien een open deur, maar toch in veel gevallen een belangrijke waarschuwing: zorg in elk geval dat betrokken medewerkers precies weten waar ze mee bezig zijn.”

Andere cruciale maatregel is daarom volgens Filip het vanaf het begin inbouwen van explainability, oftewel een heldere beslissingslogica, traceerbare datastromen, doelstellingen en beperkingen die je achteraf kunt reconstrueren. Kun je niet uitleggen waarom een AI-agent iets op een bepaalde manier deed? Dan had je het niet autonoom moeten laten handelen, en heb je mogelijk een groot probleem als je klanten en toezichthouders moet informeren dat je agent ‘op hol is geslagen’.

Ontvang elke week het beste van BusinessWise in je mailbox. Schrijf je hier nu gratis in: